Cómo adoptar IA en la empresa sin cometer los errores más comunes

Patrones de éxito y fracaso, y un framework de decisión práctico

*Artículo de lectura independiente agrupado en la serie “IA en la empresa: Expectativas vs. Realidad”*

Los artículos anteriores de esta serie han analizado los intereses de cada actor, la realidad técnica de lo que la IA puede y no puede hacer, y los costes reales incluyendo la nueva paradoja del precio. Este artículo cierra la serie con lo más práctico: qué hacer con todo eso.

La forma más directa de empezar es con lo que no funciona. Porque los errores más comunes en la adopción de IA no son técnicos: son estratégicos. Y se repiten con notable consistencia en empresas de todo tamaño y sector.

Y creo que como mejor se valora es siendo consciente de los casos extremos, la utopía y la distopía, por lo que tendremos que buscar el tono que nos vaya mejor de la escala de grises y movernos entre ellos para adaptarnos.

Dos patrones de fracaso

Patrón A: “Todo IA ya, que el mercado nos adelanta”

El patrón se desarrolla así: la dirección ve a competidores adoptando IA y siente urgencia. Se toma la decisión de “integrar IA en todos los procesos posibles”. Se fijan objetivos ambiciosos de uso (porcentaje de código generado por IA, tiempo ahorrado por herramienta) sin terminar de definir qué problema concreto se está resolviendo. Los equipos reciben la presión de usar más IA sin haber recibido la formación, el tiempo ni el contexto para hacerlo bien.

¿Qué ocurre en la práctica? Parte del equipo usa la IA para tareas de bajo valor porque es lo más fácil de justificar. Otra parte no tiene tiempo de explorarla porque sigue siendo responsable de entregar sus proyectos al mismo ritmo de antes. Algunos la usan bien. Otros producen código rápido que nadie entiende (nadie es nadie, ni quien lo produjo y tampoco la IA cuando pierda el contexto). Los directivos siguen sin ver el retorno que esperaban y exigen mayor adopción.

El ciclo se cierra sin que nadie haya definido “mayor adopción de qué, para lograr qué”.

Los síntomas de este patrón:

- Métricas de vanidad (“el X% del código lo generó la IA”) sin métricas de impacto real (tiempo de entrega, bugs en producción, velocidad de resolución de incidentes).

- Equipos que usan IA porque se les obliga, no porque les ayude.

- Costes de tokens que suben sin que el ROI mejore proporcionalmente.

- Frustración generalizada: los desarrolladores se sienten vigilados, muchos trabajadores piensan en que van a ser reemplazados, los managers no ven resultados, los directivos no entienden por qué no funciona.

- Se comienzan muchos proyectos de IA que no tienen sentido o duplicados, por presiones de quienes no entienden la base que tienen debajo y no se da tiempo ni recursos para adaptarla. Por lo que muy pocos proyectos se terminan realmente y el resto se tira.

- Reestructuración por Velocidad: cultura donde la agilidad de implementación se valora por encima de la solidez arquitectónica. Si un equipo o responsable no entrega resultados tangibles de IA en un ciclo de pocos meses, se percibe como un “cuello de botella” para la supervivencia de la empresa, lo que provoca cambios de responsabilidades o reemplazos fulminantes.

- Reemplazo “silencioso” por perfiles AI-Native: reemplazar a un “profesional tradicional” por un “profesional aumentado” (alguien que ya viene con la IA integrada en su metodología). Las empresas están forzando esta transición de manera agresiva: si no demuestras que la IA te hace un 40% más rápido en un trimestre, la empresa asume que otro perfil con menos experiencia, pero más “hambre tecnológica” sí lo hará.

- Se pierde el conocimiento de dominio (el know-how profundo de la empresa) a cambio de una velocidad superficial que genera deuda técnica masiva.

- Erosión de la seguridad laboral por la expectativa de una productividad exponencial.

- Obsolescencia programada del talento: exigir un ritmo de adaptación que ignora las curvas de aprendizaje humanas.

Patrón B: “Nosotros no usamos eso, que es humo”

El patrón opuesto también es real y también tiene sus propias patologías. En este caso, la organización o parte de ella —a veces por razones técnicas legítimas, a veces por cultura, a veces por restricciones de privacidad o infraestructura— decide no adoptar herramientas de IA o retrasa la adopción indefinidamente.

Los síntomas de este patrón:

- Desarrolladores que se sienten en desventaja respecto a sus homólogos en otras empresas.

- Incapacidad de competir en velocidad con organizaciones que sí han adoptado la IA donde tiene sentido.

- Fuga de talento hacia empresas con mejores herramientas.

- Trabajo manual en tareas donde la IA podría liberar tiempo para tareas de mayor valor.

- Perdida de control de información debido al shadow ai (uso de herramientas de Inteligencia Artificial dentro de una organización por parte de empleados o departamentos sin la aprobación, el conocimiento o la supervisión del equipo de IT o seguridad).

- Desplazamiento de la Responsabilidad: pasar la carga de la culpa al empleado, dejarle en una situación de indefensión, coaccionarle: si el empleado no usa IA se le culpa por su falta de eficiencia o por no llegar a los objetivos, pero si el empleado usa IA y algo sale mal se le culpa por infringir las normas.

Lo que tienen en común

Ambos patrones comparten el mismo fallo de base: la ausencia de una estrategia clara sobre para qué se quiere usar la IA, con qué criterios y con qué límites.

No es un problema tecnológico. Es un problema de gestión. Y la solución no es técnica: es definir primero qué problema se está intentando resolver y luego evaluar si la IA es la mejor herramienta para resolverlo.

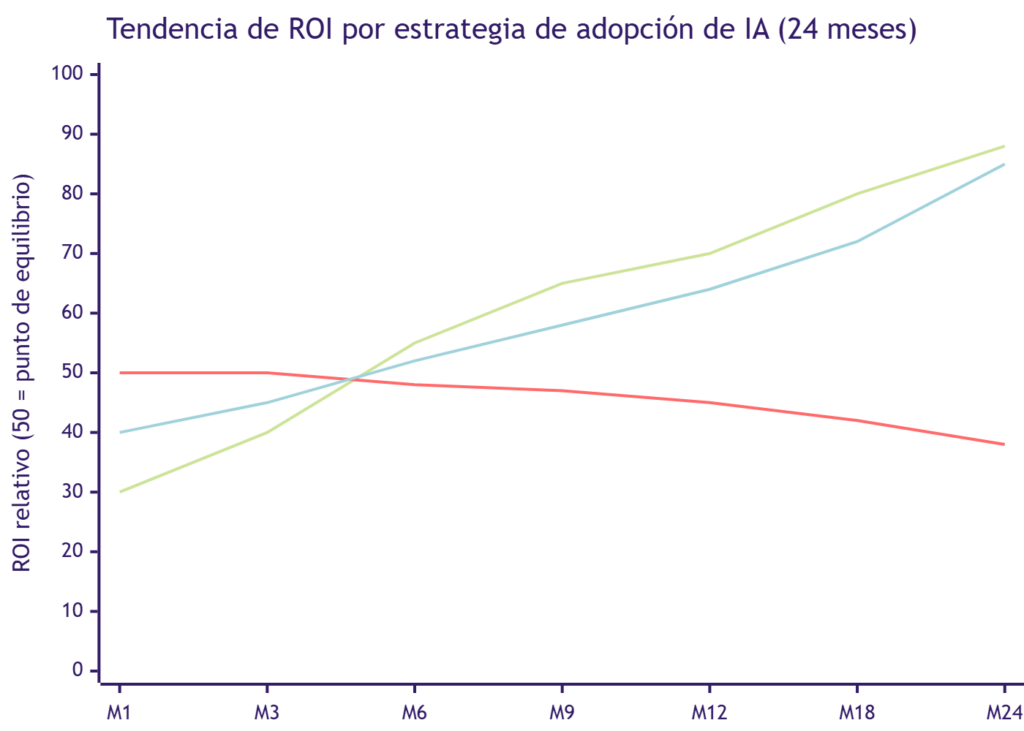

Tendencia conceptual e ilustrativa de valores inventados — los valores no corresponden a un estudio específico. El gráfico muestra el patrón cualitativo descrito en los dos patrones de fracaso anteriores.

- 🔵 Todo-IA sin estrategia: inversión inicial alta, recuperación volátil e incierta

- 🟢 Sin-IA: coste de oportunidad acumulado, declive gradual de competitividad

- 🔴 Adopción selectiva: coste inicial moderado, crecimiento sostenido

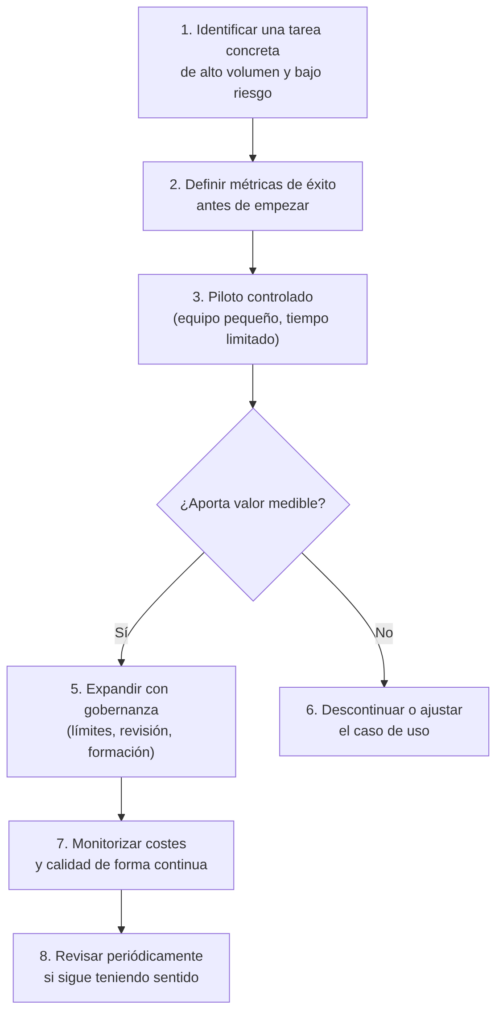

Empezar pequeño, medir, expandir

La adopción de IA que funciona sigue un patrón reconocible: comienza en un área concreta con un caso de uso bien definido, se mide el impacto real, y solo se expande a otras áreas si los resultados lo justifican.

Esto suena obvio. Y aun así, se viola constantemente porque la presión del mercado, el hype y el miedo a quedarse atrás empujan a “adoptar todo a la vez”.

El punto 2 es el más ignorado. Muchas empresas lanzan pilotos sin haber definido de antemano qué resultado les haría decir “esto funciona” o “esto no funciona”. Sin esa definición previa, cualquier resultado puede interpretarse como éxito.

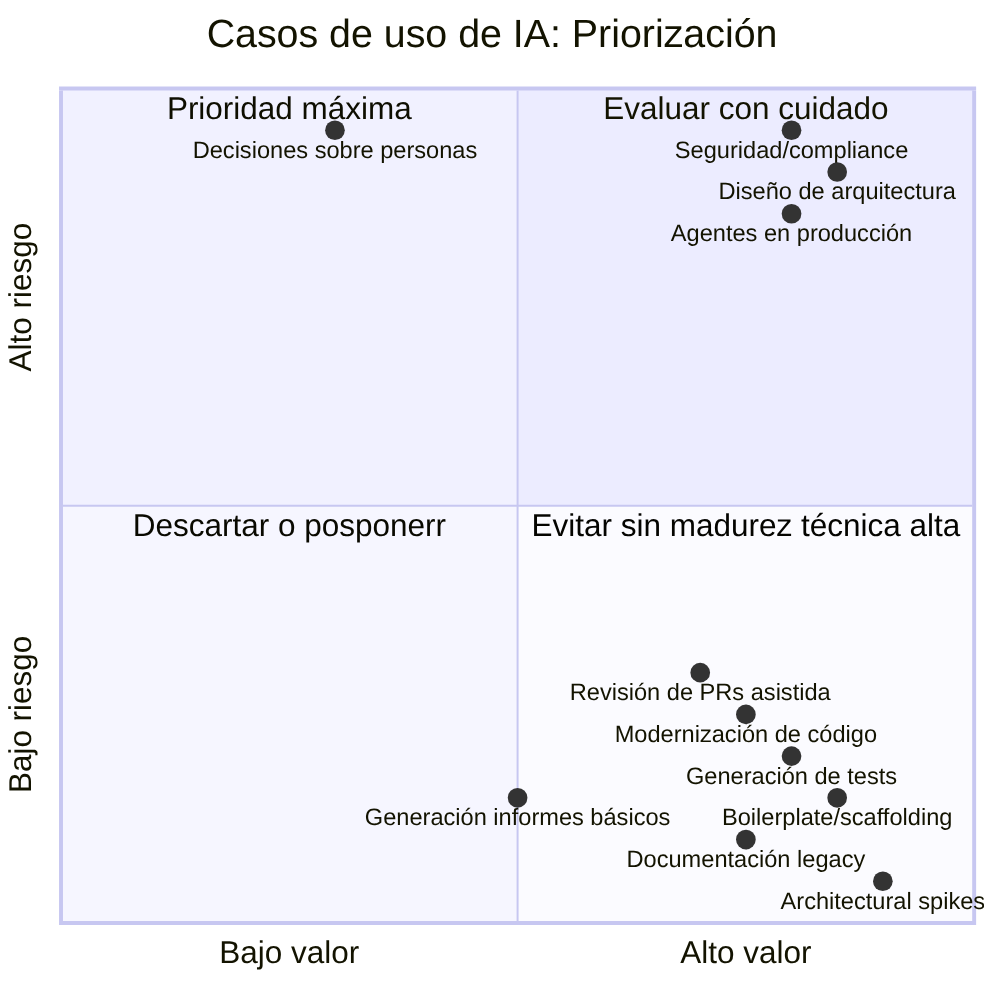

Los casos de uso donde tiene más sentido empezar

No todos los casos de uso tienen el mismo ratio de beneficio frente a riesgo. Estos son los que presentan la combinación más favorable para empezar, porque el impacto es alto y el riesgo de daño es bajo:

Generación de boilerplate y código de scaffolding

El código inicial de un proyecto (la estructura de carpetas, las configuraciones base, los archivos de ejemplo) es necesario y aburrido. La IA lo genera bien y rápido. Si está mal, se detecta en segundos porque es código simple y conocido. Riesgo: bajo. Impacto: alto.

Tests automáticos

Generar tests unitarios a partir del código existente. Los tests generados por IA no son perfectos (tienden a cubrir los casos obvios y a pasar por alto los casos límite más sutiles) pero son un punto de partida sólido que un desarrollador puede completar. Riesgo: bajo (si se revisan antes de mergear). Impacto: alto.

Documentación de código heredado (legacy)

Uno de los usos más prácticos. Pegar un módulo que lleva diez años en producción y que nadie documenta, y pedir a la IA que explique qué hace. No siempre acierta, pero como punto de partida para recuperar conocimiento perdido es valiosísimo. Riesgo: bajo (es documentación, no código de producción). Impacto: muy alto en proyectos con deuda técnica.

Architectural spikes (exploraciones arquitectónicas)

Antes de comprometerse con una solución técnica importante, generar dos o tres prototipos rápidos con la IA que prueben distintas aproximaciones. No para usar ese código en producción, sino para entender las implicaciones de cada opción antes de decidir. Es uno de los mejores usos que existe de la IA en el contexto técnico. Riesgo: ninguno (el código es desechable por diseño). Impacto: muy alto en la calidad de las decisiones arquitectónicas.

Modernización y refactorizaciones

Actualizar código de una versión antigua de un framework a una más reciente, convertir código de un patrón a otro. La IA es especialmente buena en esto porque son transformaciones con patrones claros y documentados. Riesgo: bajo con revisión humana. Impacto: alto en proyectos con deuda técnica.

Lo que NO se debe delegar a la IA (todavía)

Tan importante como saber dónde usar la IA es saber dónde no usarla de forma autónoma.

El diseño de arquitectura de sistemas críticos: la decisión de cómo estructurar un sistema no es solo técnica. Involucra el presupuesto, la cultura del equipo, los objetivos a largo plazo de la empresa, las restricciones legales y la deuda técnica específica del proyecto. Una IA no tiene contexto sobre ninguno de esos factores. Puede ayudar a explorar opciones, pero la decisión final y la responsabilidad son humanas.

La seguridad y el compliance (cumplimiento normativo): la IA puede detectar vulnerabilidades conocidas, pero la decisión de qué nivel de riesgo es aceptable para la empresa, y cómo diseñar una política de gobernanza de datos que cumpla con GDPR, el AI Act o las regulaciones específicas del sector, requiere juicio humano, conocimiento legal y responsabilidad profesional.

La gestión de incidentes críticos en producción: cuando algo falla en producción a las 3 de la mañana y hay impacto en usuarios y negocio, la IA puede dar pistas, pero no puede asumir la responsabilidad ni tomar decisiones en condiciones de alta presión con información incompleta. Ese sigue siendo territorio humano.

La toma de decisiones sobre personas: evaluación de rendimiento, decisiones de contratación, reestructuraciones de equipo. Incluso si la IA puede aportar datos o análisis, la decisión que afecta a personas debe tener supervisión humana directa y clara. Además de ser éticamente necesario, es un requisito legal bajo el AI Act europeo en muchos casos.

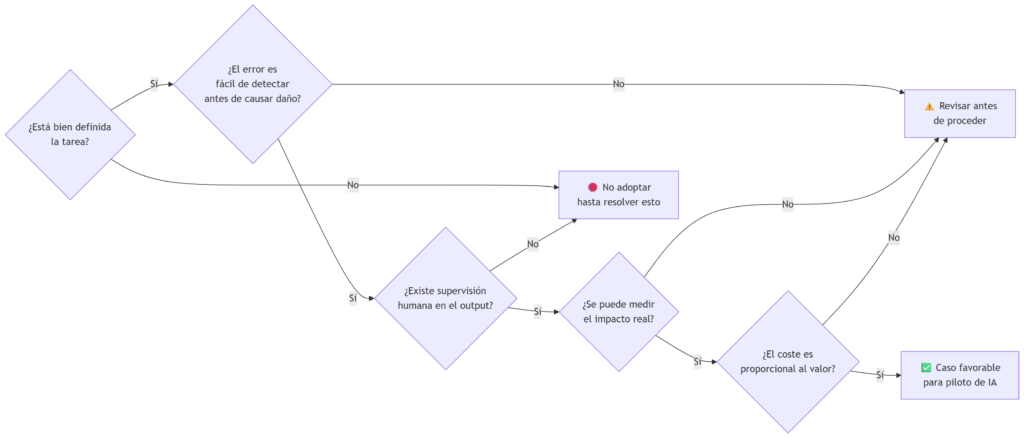

Framework de decisión: ¿tiene sentido usar IA aquí?

Antes de adoptar IA para un caso de uso concreto, vale la pena responder estas preguntas:

Las preguntas críticas:

¿Está bien definida la tarea? Si no se puede describir claramente qué input va a recibir la IA y qué output se espera, el resultado será impredecible. La IA necesita contexto preciso para funcionar bien.

¿El error es fácil de detectar antes de causar daño? En código de test, en documentación, en boilerplate: un error es fácil de ver. En configuraciones de seguridad, en código de negocio crítico, en decisiones que afectan a usuarios: un error puede llegar lejos antes de detectarse.

¿Existe supervisión humana en el output? Si la IA va a generar algo que va directo a producción sin que ningún humano lo revise, el riesgo es muy alto. La supervisión humana no tiene que ser exhaustiva, pero tiene que existir.

¿Se puede medir el impacto real? Si no hay forma de saber si la IA está aportando valor o creando problemas, es imposible tomar decisiones informadas sobre si seguir usándola. Define las métricas antes de empezar.

¿El coste es proporcional al valor? Incluyendo todos los costes: tokens, formación, gobernanza, tiempo de revisión y el coste potencial de los errores.

La matriz de riesgo vs. valor

Una herramienta práctica para priorizar qué casos de uso abordar primero:

La lectura es simple: empieza por el cuadrante de alto valor y bajo riesgo (arriba a la derecha en valor, abajo en riesgo). Los casos de alto valor y alto riesgo requieren madurez técnica y gobernanza sólida antes de abordarlos. Los de bajo valor y alto riesgo, simplemente no los abordes.

Gobernanza mínima viable

La gobernanza de IA no tiene que ser un proyecto de seis meses. Puede empezar con un conjunto mínimo de reglas que cualquier equipo puede adoptar en una semana:

1. Define qué puede hacer la IA y qué no: Por escrito, en el repositorio del proyecto. No el código de conducta de todo el universo: las reglas concretas para este equipo y este proyecto. Ej: “La IA puede generar tests y documentación. No puede hacer merge a main sin revisión humana. No puede acceder a credenciales de producción.”

2. Establece límites de gasto: Configura alertas en la herramienta de facturación cuando el consumo supere un umbral. Si no sabes cuánto estás gastando en tiempo real, no puedes gestionar el presupuesto.

3. Revisión humana obligatoria: Todo código generado por IA que va al repositorio pasa por revisión humana. El revisor no tiene que leer cada línea en detalle, pero sí tiene que entender qué hace el cambio y por qué.

4. Registro de incidentes relacionados con IA: Si la IA produce un bug que llega a producción, o una alucinación que casi pasa inadvertida, regístralo. Esos datos son valiosos para calibrar en qué contextos confías en la IA y en cuáles no.

5. Revisión periódica: Cada trimestre, revisa si los casos de uso que adoptaste siguen teniendo sentido y si los costes siguen siendo proporcionales al valor. La IA cambia rápido y lo que funcionaba hace seis meses puede no ser la mejor opción hoy.

Cómo medir el ROI real

El ROI de la IA no se mide en “porcentaje de código generado por IA” ni en “número de herramientas adoptadas”. Se mide en impacto sobre los indicadores que importan al negocio:

| Lo que mide el management | Lo que habría que medir |

|---|---|

| % de código generado por IA | Tiempo medio de entrega de funcionalidades (con y sin IA) |

| Número de herramientas adoptadas | Frecuencia de bugs en producción (antes y después) |

| Horas de “uso” de la IA | Coste total de un sprint / entregable (incluyendo revisiones y correcciones) |

| Velocidad de generación de código | Tiempo de incorporación de nuevos desarrolladores al proyecto |

Hay que tener en cuenta Ley de Goodhart, que lo resume mejor que cualquier argumento: “cuando una medida se convierte en objetivo, deja de ser una buena medida”.

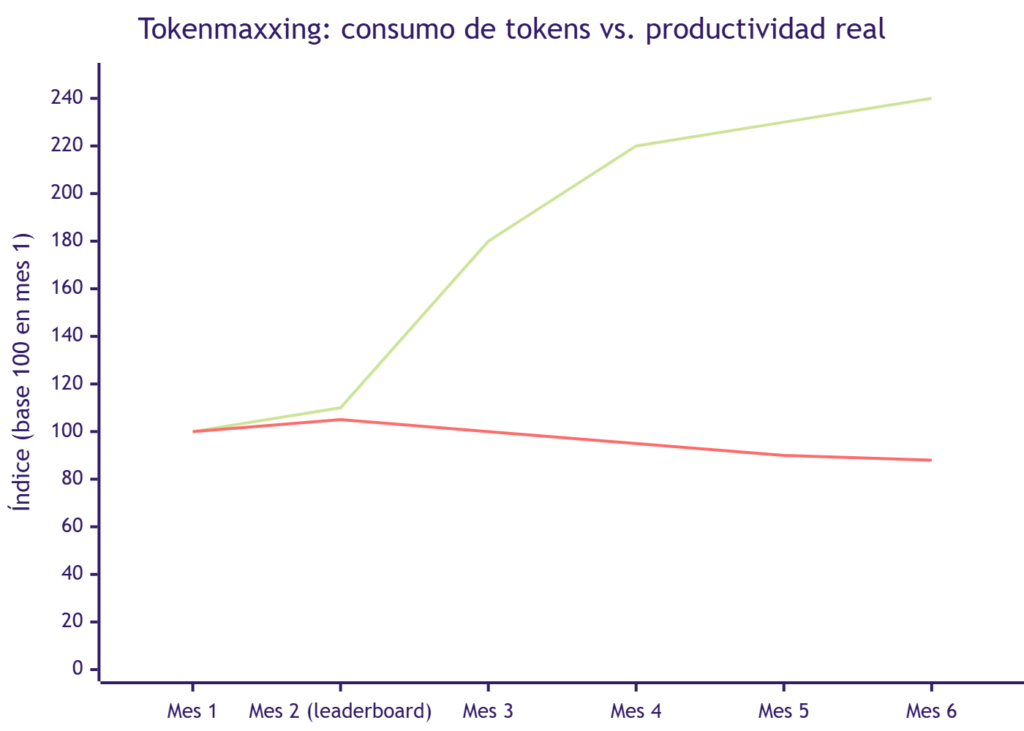

Un ejemplo es cuando se introduce un leaderboard (tabla de clasificación) de uso de IA en una empresa. El objetivo de incentivar el uso de IA puede llevar a un tokenmaxxing, donde los empleados intentan maximizar el consumo de tokens para mejorar sus puntuaciones en el leaderboard, sin importar el impacto real en la productividad del negocio. Sobre esto hablamos en otro artículo cuando abordamos el caso del tokenmaxxing

Ilustración conceptual del patrón tokenmaxxing descrito en el párrafo anterior. Los valores son inventados para mostrar la forma de la curva, no métricas reales.

- 🟢 Consumo de tokens (sube bruscamente tras introducir el leaderboard)

- 🔴 Productividad real medida en entregas (se estanca y decrece)

La métrica que más se ignora y más importa: el tiempo de onboarding (incorporación) de un nuevo desarrollador al proyecto. Un proyecto donde la IA generó la mayor parte del código sin documentación sólida tiene un coste de onboarding altísimo. Un proyecto donde te puede acompañar otra persona que sabe, el código es legible y comprensible tiene uno bajo. Esa diferencia es valor económico real.

Recomendaciones por perfil

Si eres CEO o directivo

No fijes objetivos de uso de IA sin haber definido primero qué problema de negocio concreto se está resolviendo. “Usar más IA” no es una estrategia: es una instrucción sin propósito.

Pregunta siempre: ¿cómo sabremos que esto está funcionando? Si nadie en la sala puede responder esa pregunta con métricas concretas, el proyecto de adopción no está listo para empezar.

Y protege el know-how interno: la velocidad que ganas con la IA se pierde por completo si pierdes a las personas que entienden los sistemas críticos.

Si eres CTO o arquitecto

Tu trabajo con la IA es el mismo de siempre: tomar decisiones técnicas que sean buenas a largo plazo, no solo rápidas a corto plazo. La IA puede ser una herramienta poderosa en ese proceso, pero la responsabilidad de las decisiones sigue siendo tuya.

Diseña la gobernanza antes de que el equipo necesite improvisar. Define los límites de lo que la IA puede hacer autónomamente antes de que alguien cometa el error de cruzarlos.

Si eres desarrollador

Usa la IA en lo que te libera para pensar más, no en lo que te evita pensar. Si aceptas sugerencias que no entiendes porque “la IA dice que funciona”, estás transfiriendo tu criterio técnico a una herramienta. Ese criterio es lo que te hace valioso.

Mantén tu capacidad de trabajar sin la IA. No como ejercicio de purismo, sino como seguro: el día que la IA falle, el sistema se caiga o el proveedor cambie sus condiciones, seguirás siendo capaz de resolver los problemas.

Si eres mánager o PM

Redefine tus métricas de rendimiento del equipo. Las métricas tradicionales (líneas de código, tickets cerrados) se distorsionan con la IA. Lo que importa sigue siendo lo mismo que siempre: ¿el equipo entrega valor real? ¿el sistema funciona bien? ¿el equipo puede mantener y mejorar lo que ha construido?

No presiones por “más uso de IA”. Presiona por mejores resultados. Si la IA ayuda a conseguirlos, el equipo la usará. Si no, hay que revisar el caso de uso, no aumentar la presión.

El resumen que vale para todos

Ninguna herramienta, por potente que sea, sustituye a una estrategia clara. La IA es una herramienta extraordinariamente capaz en dominios concretos y bastante mala en otros. El trabajo de cualquier organización que quiera beneficiarse de ella no es “adoptar IA”: es entender qué hace bien, qué hace mal, qué cuesta y qué implica para las personas del equipo.

La fórmula no es IA vs. Humano. Es:

[Humano que sabe lo que hace + IA bien dirigida] > cualquiera de los dos por separado

Pero esa fórmula solo funciona si el humano sabe lo que hace. Si el humano delega el criterio a la IA, la fórmula colapsa. El humano se convierte en un multiplicador de los errores de la IA en lugar de en el filtro que los evita.

La empresa que gana a largo plazo no es la que tiene la IA más potente. Es la que tiene los equipos más capaces de entender, dirigir, cuestionar y corregir lo que la IA produce.

No hay una respuesta única sobre si la IA es buena o mala para tu empresa, tu equipo o tu carrera. La respuesta depende de para qué la usas, con qué criterio, con qué gobernanza y en qué contexto.

Lo que sí hay es información suficiente para hacer preguntas mejores y tomar decisiones más informadas. Esto es exactamente lo que se pretendía con estos artículos.

Fuentes citadas en este artículo:

- Caso tokenmaxxing en Amazon y Meta (mayo 2026): The Decoder · TechSpot · Tom’s Hardware

- Ley de Goodhart y métricas de IA en empresas: PYMNTS — Enterprises Look Beyond Token Counts

- Holded — estrategias de adopción responsable de IA: Aprovechar la IA sin perder la ventaja humana

- The Conversation — IA y aprendizaje organizativo: La IA facilita pero no garantiza el aprendizaje

Artículo anterior: [El coste real de la IA: de la promesa democrática al modelo enterprise]